【大纪元2025年01月28日讯】(大纪元记者林燕报导)中国人工智能公司DeepSeek引发华尔街震荡,外界却发现这家杭州小型新创公司的消息是寥寥无几。其拒绝任何国内外媒体的采访。

周一(1月27日),中国人工智能公司“深度求索”(DeepSeek)引发华尔街AI股估值担忧,英伟达跌近17%,市值蒸发近6000亿美元为美股史上规模最大。

DeepSeek的研究人员2024年12月在公开网站alphaXiv发表了一篇论文称,他们即将在1月10日推出的DeepSeek-V3模型在多项数据上超越国内外一众大模型产品,但他们使用的是英伟达(Nvidia)的非高端H800芯片训练,且训练成本仅557万美元。

随后,他们在1月20日又发布推理模型DeepSeek-R1,称性能比肩OpenAI o1正式版。

在经过一周的疯传和发酵后,DeepSeek登上苹果美国应用商店下载排行榜榜首。这让外界对英伟达最快最强芯片的必要性和竞争力,以及对科技公司天价投资AI模型和数据中心产生了质疑。

周一,除了芯片制造商,数据中心服务商和为AI基建提供电力的核电概念股也普遍重挫,因为人们担心DeepSeek的出现会导致未来AI基建设施的支出、所需芯片数量和能源需求都会低于预期。

DeepSeek周一稍晚称,因遭遇“大规模恶意攻击”而限制海外用户注册。

陆媒宣称“偷袭珍珠港” DeepSeek谢绝所有采访

大陆媒体高调宣传周一的华尔街震荡,称DeepSeek上演了一场“偷袭珍珠港”戏码。

这家位于杭州市拱墅区环城北路169号汇金国际大厦西1幢1201室的神秘公司拒绝任何媒体探访。

陆媒《21世纪经济报导》说,“在这突然爆红之际,DeepSeek却选择了“深潜”,不想与外部有任何形式的交流互动。”

有投资人向《21世纪经济报导》记者透露,“找他们的人踏破门槛了,”“最近几波我们去约都没约上”。

DeepSeek的“官方交流98群”公告上说,“暂不对外进行项目合作,不提供私有化部署及相关支持服务;DeepSeek将集中研发精力奉上更强的模型,尽情(敬请)期待!”

根据中共官媒新华社报导,就在DeepSeek-R1发布的当天,其创办人梁文锋参加了由中共国务院总理李强主持的一场企业家和专家闭门座谈会。

梁文锋出席会议可能表明,DeepSeek的成功对于北京认为克服华盛顿的出口管制、实现人工智能等战略产业的自给自足的政策目标至关重要。

这场会议作为当天的重要活动,在中共喉舌中央电视台的《新闻联播》节目播出。

引发华尔街震荡 550万训练成本遭质疑

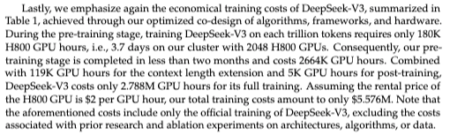

根据大纪元查询的DeepSeek发表的论文,这个被美国媒体广为引用的550万美元训练成本实际上是DeepSeek-V3,而不是R1,而且即便如此,它也只是V3实际训练成本的一小部分。

“上述成本仅包括DeepSeek-V3的正式训练,并不包括与架构、算法或数据方面的先前研究和实验相关的所有其它成本。”论文写道。

DeepSeek发表的原始报告中有详细解释这笔成本的计算。“在预训练阶段,每兆个token上训练DeepSeek-V3仅需要180K H800 GPU小时,也就是说,在我们拥有2048个H800 GPU的丛集上需要3.7天。因此,我们的预训练阶段在不到两个月的时间内完成,耗费2664K GPU小时。加上上下文长度扩充所需的119K GPU小时和后制训练所需的5K GPU小时,DeepSeek-V3的完整训练仅需2.788M GPU小时。假设H800 GPU的租赁价格为每GPU小时2美元,我们的总训练成本仅为557.6万美元。”

伯恩斯坦研究公司美国半导体和半导体资本设备董事总经理、高级分析师斯泰西·拉斯贡(Stacy Rasgon)在一份报告中更直言,DeepSeek的训练成本的数字具有很大的误导性。

“DeepSeek 真的‘以五百多万美元创立了OpenAI’吗?当然不是。”他质疑到。

他解释说,DeepSeek-V3是一个“混合专家”模型,“透过一系列优化和巧妙的技术,可以提供与其他大型基础模型相似或更好的性能,但只需要一小部分计算资源来训练”。

拉斯贡表示,这种类型的模型旨在“显着降低训练和运行成本,因为在任意时刻,只有一部分参数集处于活动状态”。

值得注意的是,DeepSeek没有公布其R1模型的成本。如果说DeepSeek R1比肩OpenAI o1,R1的成本数据更关键。

“DeepSeek的R1论文没有量化开发R1模型所需的额外资源”,拉斯贡写道,“大概这些资源(耗费)也相当可观。”

全球咨询公司DGA Group的合伙人保罗·特里奥洛(Paul Triolo)在Substack上撰文说,“OpenAI的o1的训练成本肯定远超过GPT-4,同样,(DeepSeek)R1的训练成本也肯定高于V3。从o3到o4/o5或从R1到R2/R3,训练计算只会增加。”

美国资本公司Archerman Capital也质疑了550万美元的成本宣传。他们的报告指出,有人称,DeepSeek的训练成本是550万美元,是Meta的十分之一,OpenAI的廿分之一,好像比后两者厉害10倍、20倍。但是,Meta和OpenAI花的钱多是因为前沿探路,探路就意味着就会有浪费,而后发追赶是站在别人的肩膀上,当然可以避开很多浪费。

“打个不恰当的比方,创新药的研发需要十年几十亿美元,而仿制药的研发一定会更快更省,另外成本的统计口径也没有统一的标准,可以有很大的差别。”报告写道。

到截稿前,DeepSeek没有回应大纪元的置评请求。◇

责任编辑:叶紫微#